Les IA contemporaines: instruments de guerre non-cinétique qu'on traite comme des agents sociaux

Les produits d'IA conversationnelle et cognitive sont souvent vus comme des faits accomplis techniques, là où ils doivent être pensés comme les derniers composants en date d'une guerre non-cinétique.

La lecture d’un article récent de Fred Cavazza, représentatif de la pensée dominante sur ce que l’on appelle l’IA par abus de langage, montre l’importance d’expliciter les limites du cadre “d’adaptation” qui nous est proposé comme une voie incontournable.

Cette nécessité d’adaptation est présentée comme applicable à tout le monde, sauf aux instigateurs et propriétaires actuels des produits en question.

Le déploiement de produits à base d’apprentissage machine massif, positionnés comme des intelligences artificielles conversationnelles et cognitives, est régulièrement présenté comme une “rupture civilisationnelle” (sic), avec toutes sortes d’idées allant du concept de “travailleur virtuel” aux “équipes hybrides” en passant par le “travail synthétique”. Derrière ces concepts, il s’agit d’imposer un véritable fait accompli technique dont il serait vain de questionner les fondements et les principes. Cela nous imposerait naturellement – et à des fins de survie matérielle, sociale, voire intellectuelle – une adaptation… Cette nécessité d’adaptation est présentée comme applicable à tout le monde, sauf aux instigateurs et propriétaires actuels des produits en question. Ainsi, il serait judicieux d’intégrer “les IA” comme parties prenantes actives de nos systèmes juridiques, économiques, sociaux et – soyons fous, “disruptons”, que diable! – politiques, au même titre que les “personnes morales” que sont nos entreprises et associations. C’est ce type de thèse qui a mené au fameux – et funeste – cas “Citizens United v. US” devant la Cour Suprême étatsunienne, dont la décision a permis à quelques milliardaires d’acheter leur accès au pouvoir exécutif du pays, en particulier lors de la dernière élection présidentielle – et vous pouvez prendre “dernière” dans l’acception que vous voulez, car toutes pourraient s’avérer exactes. Mais, est-il raisonnable de considérer une personne morale capable de mobiliser des moyens considérables comme “un citoyen” normal autorisé à avoir des opinions politiques? Quid d’instances d’IA dont on veut d’un côté protéger les opérateurs en les considérant comme des “plateformes neutres” sans responsabilité pour ce que font leurs usagers des capacités qu’elles leur vendent, et de l’autre permettre une participation asymétrique dans les collectivités humaines?

Les milliardaires et autres entrepreneurs qui prétendent aujourd’hui que la démocratie entrave leur liberté ont bâti leurs fortunes sur le substrat de l’investissement public. Ce n’est pas simplement ironique. C’est une hypocrisie structurelle.

Du reste, la question des principes ou de l’autorité en vertu de laquelle ces produits de simulation cognitive sont déployés à une échelle telle que les systèmes énergétiques en sont affectés et avec eux les limites planétaires, n’aurait pas à être posée. Ce n’est pas seulement une question d’institutions : c’est une augmentation massive de throughput – calcul, énergie, infrastructures de refroidissement – décidée hors de toute délibération et aux dépens des limites planétaires.

Quant aux conséquences, elles doivent bien être supportées par tous puisque ces systèmes débordent de vertus évidentes et d’atouts dont la société toute entière pourra bénéficier dans un “futur radieux”. Pourtant, si nous posons la question de savoir en vertu de quelle autorité ces systèmes sont déployés pratiquement sans aucun cadre légal digne de ce nom, la réponse est évidente: la logique du marché et l’accumulation de capitaux privés, et non la délibération démocratique.

Considérons ce que sont réellement les modèles d’IA : ils sont entraînés à partir des connaissances accumulées par l’humanité – recherche publique, éducation ouverte, Wikipédia, articles universitaires, livres, forums, référentiels de code. Il s’agit de connaissances produites collectivement, un bien commun au sens où l’entend Elinor Ostrom dans ses travaux reconnus par un Prix Nobel d’Economie en 2009. Pourtant, leur valeur a été appropriée et privatisée par une poignée d’entreprises sans aucun accord de gouvernance, sans mécanisme de compensation, sans consentement des ayant-droits et sans intégration d’une réflexion sur le bien commun. L’extraction des données d’entraînement ressemble structurellement aux appropriations antérieures les plus extrêmes, dont une caractéristique est de faire peser les conséquences et “externalités” négatives sur la société, pendant que les bénéfices sont captés par les intérêts particuliers.

La structure de ce texte suit la boucle OODA (Observer, S’Orienter, Décider, Agir) développée par le stratège John Boyd. Face à une situation de guerre non-cinétique, l’analyse académique ne suffit pas: il faut produire une intelligence stratégique qui permette de se situer et d’agir.

Observer le contexte

Le cadre de guerre non-cinétique

L’idée de “guerre non-cinétique” n’est pas une simple métaphore, mais une analyse structurelle de ce qui se passe sous nos yeux. La guerre consiste à utiliser une force coordonnée pour atteindre des objectifs politiques qui ne peuvent être atteints par des processus politiques légitimes. La guerre non cinétique permet d’atteindre ces objectifs sans recourir à la force militaire conventionnelle, mais par le biais de pressions économiques, d’opérations d’information, de la mainmise sur les institutions et de l’érosion des capacités de l’adversaire.

Ce cadre décrit précisément ce qui est en cours : érosion de la base fiscale qui soutient les protections sociales, concentration des richesses et des capacités dans des entités qui opèrent largement en dehors de toute responsabilité démocratique, perturbation des marchés du travail à un rythme qui empêche toute réponse adaptative, et manipulation potentielle de l’environnement informationnel dont dépend la délibération démocratique. Il ne s’agit pas de dommages collatéraux, mais de conséquences structurelles qui redistribuent le pouvoir des institutions collectivement organisées vers des acteurs privés.

L’évolution historique

Il s’agit là du dernier coup en date porté à l’ordre libéral démocratique organisé collectivement tel qu’il est né des années Roosevelt et de la situation de l’après-guerre. Cet accord visait essentiellement à reconnaître l’importance du bien commun pour éviter des crises comme 1929 ou l’émergence du fascisme, à limiter l’autonomie du capital, et à permettre une stabilité sociale : droits du travail, fiscalité progressive, marchés réglementés, investissements publics.

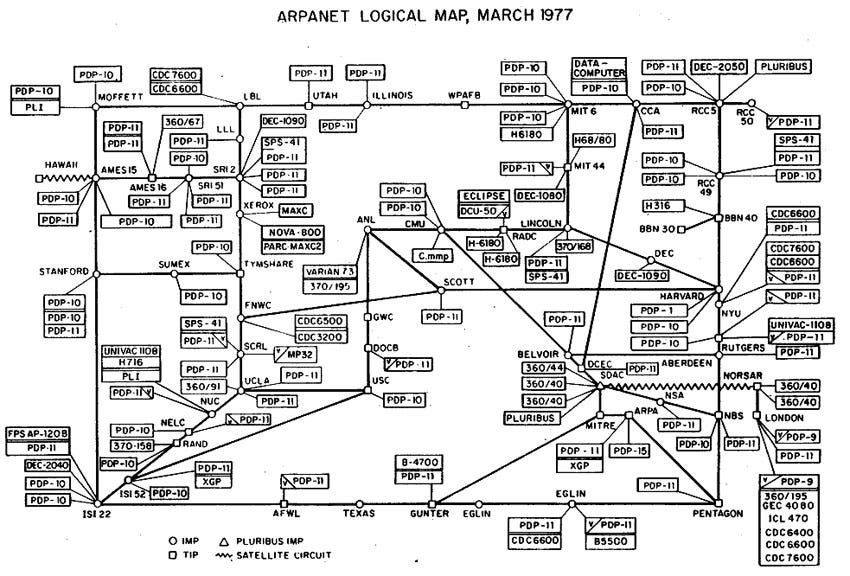

Parmi ces investissements publics : le DARPA, fondé le 7 février 1958, sans lequel aucun des prétendus “self-made” entrepreneurs de la Silicon Valley n’aurait connu tant de succès individuel. Les milliardaires et autres entrepreneurs qui prétendent aujourd’hui que la démocratie entrave leur liberté ont bâti leurs fortunes sur le substrat de l’investissement public. Ce n’est pas simplement ironique. C’est une hypocrisie structurelle.

Le déploiement de l’IA tel qu’il est actuellement constitué inverse complètement cette situation :

Éroder la base fiscale de l’État démocratique en remplaçant le travail imposable par des systèmes basés sur le capital, bénéficiant d’un différentiel majeur de traitement fiscal, ce qui, poussé à l’extrême, compromet le fondement du contrat social.

Concentrer le pouvoir décisionnel dans des entités qui opèrent en dehors de toute responsabilité démocratique.

Enfermer un patrimoine commun de connaissances (le résultat cognitif accumulé de l’humanité utilisé pour la formation) sans consentement, compensation ou gouvernance.

Perturber les marchés du travail à un rythme qui empêche toute réponse démocratique adaptative.

Compromettre l’environnement informationnel – et même la capacité cognitive des citoyens dès le plus jeune âge – dont dépend la délibération démocratique.

S’orienter dans ce contexte

Ce qui est forclos

Aujourd’hui on amplifie l’autonomie du capital tout en réduisant le citoyen à un rôle de figurant tout juste bon à consommer, en phagocytant les espaces de l’action collective et en évitant soigneusement de développer la gouvernance des communs telle qu’elle est pratiquée par des collectivités localisées depuis des siècles – le cas échéant en vendant l’idée erronée, et largement contredite par les réalités de terrain, de tragédie des communs selon laquelle on n’aurait que le choix du privé ou du contrôle gouvernemental pour gérer les communs.

Considérer le déploiement de l’IA comme une forme de guerre – qu’on peut qualifier de “non-cinétique” puisqu’il n’y a pas de mouvement de troupes ou de matériel – plutôt que comme un « changement technologique » réputé inévitable et auquel on n’aurait qu’à s’adapter (en somme un TINA 2.0 – le fameux There Is No Alternative de Thatcher et de tant de partisans du managérisme, cette maladie consistant à intégrer des managers sans compétences sectorielles dans des domaines où la gouvernance devrait réserver des sujets aux professionnels du cœur de métier) conduit aux conclusions suivantes :

L’adaptation n’est pas neutre. Les propositions visant à « intégrer l’IA dans nos systèmes sociaux » peuvent être des réponses raisonnables de la gouvernance à la technologie, ou elles peuvent être des conditions de capitulation face à une campagne politique. Cela dépend de qui fixe les conditions.

La vitesse est transformée en arme. Le rythme du déploiement, quitte à raconter n’importe quoi sur les capacités réelles de la technologie, n’est pas accidentel : il est conçu pour devancer la réponse démocratique. C’est la théorie révoltante du “move fast and break things” sans aucune réflexion sur les conséquences ou la réversibilité de ce que l’on casserait. Voir notamment l’immense fiasco qu’a été DOGE – la tentative chaotique de Musk de 'disrupter' l'administration fédérale américaine, qui lui a donné un accès excessif et préoccupant aux données de l’Etat fédéral US, dont celles des entités de régulation de ses activités – et dont l’Amérique ne se remettra pas, notamment au niveau de la recherche en physique et en étude du climat.

La question de la gouvernance est prioritaire. Avant de se demander “comment taxer l’IA ?” ou “comment réglementer l’IA ?”, nous devons nous demander : avons-nous encore la capacité politique de le faire ? Si ce n’est pas le cas, aucune proposition politique n’a d’importance.

La résistance n’est pas du luddisme. Remettre en question la légitimité du déploiement de l’IA n’est pas s’opposer à la technologie. C’est questionner le projet politique que la technologie sert à faire avancer.

Les questions qu’il faut traiter

Dans le contexte, et pour continuer à se faire une idée de l’orientation et de la doctrine stratégique à adopter, il faut encore traiter au moins des questions suivantes:

Que signifierait et que permettrait le fait de gérer comme un commun le patrimoine intellectuel et la base de connaissance de l’humanité plutôt que de permettre son appropriation?

Comment les institutions démocratiques pourraient-elles réaffirmer leur capacité face aux efforts coordonnés visant à l’éroder?

Quelles formes d’action collective restent disponibles lorsque les outils de coordination sont eux-mêmes détenus par des ennemis de l’action collective? Pour être clair, il ne s’agit pas de promouvoir une forme nouvelle de collectivisme ou de communisme, mais simplement de reconnaître que l’espèce humaine est dépendante de sa capacité à organiser sa réalité collective parce que l’humanité est une forme de vie sociale et politique mal adaptée à la survie à l’échelle de l’individu.

L’ordre instauré après la Seconde Guerre mondiale mérite-t-il d’être défendu? Si ce n’est pas le cas, par quoi devrait-il être remplacé et qui en déciderait? Ici, l’objectif n’est pas de revenir à ce qu’était le monde d’après-guerre ou de dire que c’était mieux alors, mais bien d’exiger une discussion explicite et argumentée sur la direction que l’on prend au lieu de la subordonner à l’affirmation abusive selon laquelle l’innovation et le progrès technique sont synonymes de progrès humain. Ce n’est simplement pas vrai. Le monde romain, conquérant l’espace physique de la Grèce Antique, ne sut jamais aller au-delà de l’utilité fonctionnelle de la connaissance, ce qui fit son délitement car on n’abandonne pas impunément la science, la philosophie et les arts au profit exclusif de l’ingénierie, de la technique et des outils.

Quel “provisioning system” – au sens du papier O’Neill, D.W., Fanning, A.L., Lamb, W.F., & Steinberger, J.K. (2018). A good life for all within planetary boundaries. Nature Sustainability, 1, 88-95. – devrait être utilisé pour ces nouvelles capacités, qui devrait les régir et comment les bénéfices devraient-ils être répartis, étant donné que les communs en supportent les coûts, les risques et les conséquences?

Ce ne sont pas des questions rhétoriques. Ce sont les conditions d'une délibération que le rythme du déploiement est précisément conçu pour empêcher.

Décider dans ce contexte

Les cinq questions posées ci-dessus ne sont pas des sujets de réflexion académique. Ce sont des points de décision qui requièrent une délibération collective –précisément ce que le rythme de déploiement est conçu pour empêcher.

Avant de pouvoir trancher sur le fond, une décision préalable s’impose: acceptons-nous le cadre d’adaptation qu’on nous propose, ou exigeons-nous que la question de la gouvernance soit posée avant celle de l’intégration ?

Accepter le cadre d’adaptation, c’est décider – implicitement – que les conditions du déploiement seront fixées par ceux qui le conduisent. Refuser ce cadre, c’est décider que la légitimité démocratique précède l’efficacité technique.

Les critères d’évaluation de toute réponse devraient inclure:

Gouvernance des communs : la proposition respecte-t-elle les principes d’Ostrom—limites claires, proportionnalité coûts/bénéfices, arrangements de choix collectif, surveillance, sanctions graduées, résolution des conflits, gouvernance polycentrique ?

Adéquation du système de provisionnement : la proposition permet-elle de satisfaire les besoins humains fondamentaux dans le respect des limites planétaires, ou renforce-t-elle un système déjà en dépassement ?

Préservation de la capacité démocratique : la proposition renforce-t-elle ou érode-t-elle la capacité des institutions démocratiques à gouverner effectivement ?

Toute proposition qui échoue sur ces trois critères – quelle que soit sa sophistication technique ou son caractère raisonnable apparent – constitue une capitulation déguisée en adaptation.

Agir dans ce contexte

L’action collective à l’échelle requise reste contingente aux décisions qui n’ont pas encore été prises collectivement. Les institutions capables de porter cette délibération sont précisément celles que le déploiement actuel contribue à affaiblir.

Cela ne signifie pas que toute action soit impossible. Mais cela impose une lucidité sur ce qui est actuellement à notre portée:

Refuser le cadre narratif. Chaque fois que le déploiement de l’IA est présenté comme un fait accompli technique requérant adaptation, nommer ce cadrage pour ce qu’il est : une revendication politique déguisée en nécessité.

Exiger la délibération. Insister pour que les questions de gouvernance soient posées avant les questions d’intégration — dans les organisations, les institutions publiques, les espaces de débat.

Construire la capacité de réponse. Développer les compétences analytiques permettant de distinguer les propositions qui renforcent la capacité démocratique de celles qui l’érodent sous couvert d’adaptation.

Documenter ce qui se passe. La légitimité future de toute réponse dépendra de la capacité à établir ce qui s’est passé, comment, et au bénéfice de qui. L’histoire ne s’écrit pas toute seule.

Ce ne sont pas des actions à la mesure de l’enjeu. Mais ce sont les conditions préalables à des actions qui pourraient l’être. La première forme de résistance consiste peut-être à insister pour que les bonnes questions soient posées – et à refuser de se laisser enfermer dans un cadre où elles ne peuvent pas l’être.